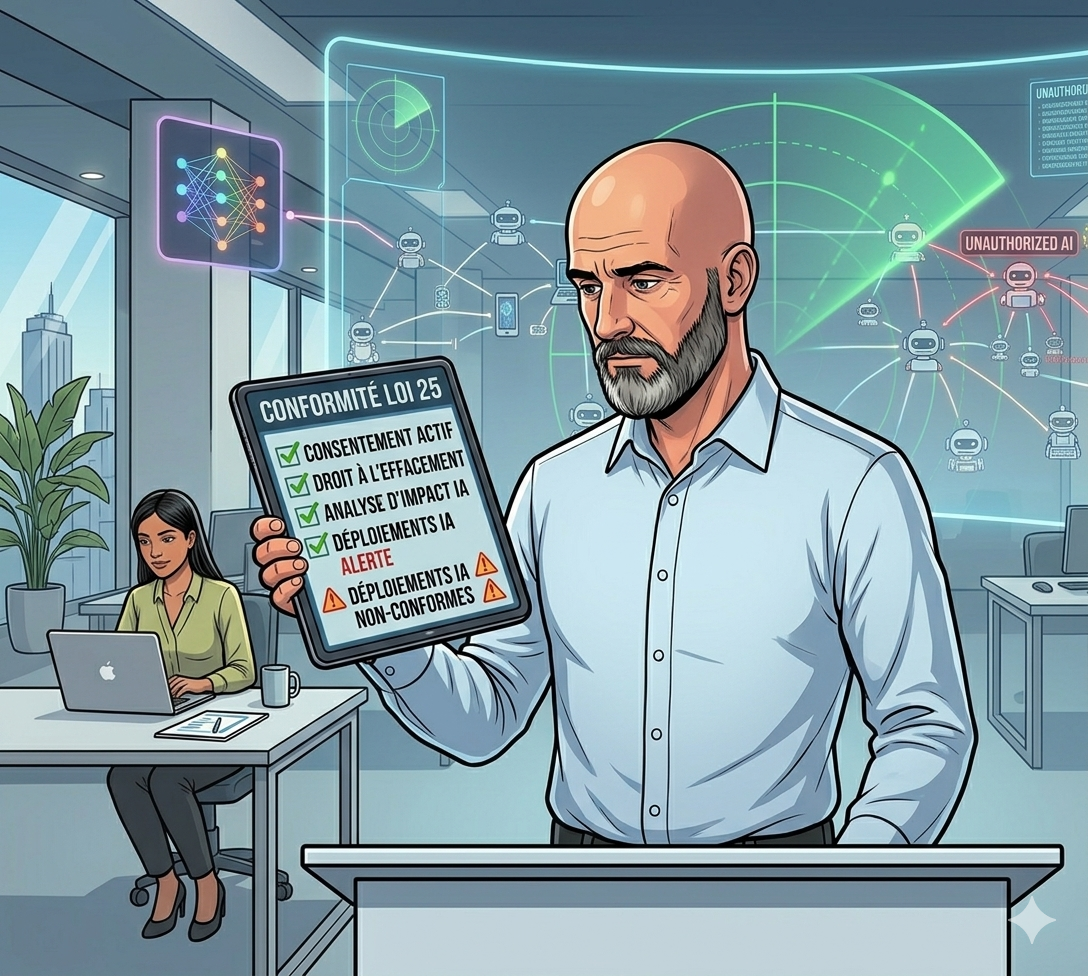

Le régulateur québécois de la vie privée a passé les deux premières années de la Loi 25 à agir en collaboration. L’approche annoncée de la CAI était d’aider les organisations à se conformer, pas de les sanctionner. Cette posture est en train de changer. La Commission a signalé que les audits de conformité deviendront plus systématiques en 2026, et son orientation d’application porte explicitement sur les défaillances structurelles dans les déploiements d’IA, pas sur les incidents ponctuels.

La plupart des organisations québécoises traitent encore la Loi 25 comme une question de vie privée réglée par leur service juridique en 2023. Elles ont rédigé les avis de consentement, fait l’inventaire des données, et passé à autre chose. L’article 12.1 couvre des décisions que bien des organisations ne considéraient pas comme automatisées.

Ce que dit concrètement l’article 12.1

Si votre organisation prend une décision exclusivement par traitement automatisé concernant une personne, et que cette décision produit des effets juridiques ou significatifs similaires, vous devez en informer la personne au plus tard au moment où elle lui est communiquée. Vous devez divulguer les renseignements personnels utilisés, les principaux facteurs ayant mené au résultat, et le droit de demander une révision humaine. Système développé à l’interne ou acquis auprès d’un fournisseur : même obligation.

Cette définition englobe tranquillement les trieurs de CV par IA, les modèles de cotation de crédit et de tarification d’assurance, les agents conversationnels qui résolvent des décisions de compte sans relais humain, les systèmes analytiques qui signalent automatiquement des comptes pour fermeture, et les copilotes internes dont les décisions sont entérinées sans modification. La plupart vivent dans les RH, le service à la clientèle ou les opérations client, pas dans l’équipe de science des données qui connaît la notion d’évaluation d’impact algorithmique.

Le problème pratique : peu d’organisations ont cartographié leur surface IA en regard de cette obligation. J’ai vu des responsables de la conformité capables de lister chaque contrat de sous-traitance de données, mais incapables de nommer les systèmes IA actifs dans leur pipeline RH. Cet écart, c’est le risque d’audit.

Ce que je ferais ce trimestre

Inventorier chaque outil d’IA utilisé, y compris ceux intégrés dans des plateformes SaaS (LinkedIn Recruiter, votre SIRH, votre CRM, votre plateforme de soutien). Pour chacun, deux questions : produit-il une décision qui affecte une personne, et cette décision est-elle prise exclusivement par automatisation sans révision humaine significative ? Un employé qui approuve 199 recommandations sur 200 par jour n’exerce pas une révision significative. La CAI a indiqué qu’elle regarde la pratique, pas le libellé des politiques.

Chaque outil dans le cadre exige trois livrables : une ÉFVP en vertu de l’article 3.3, un avis de divulgation conforme à l’article 12.1, et un mécanisme de révision humaine documenté. L’absence de l’un est ce qui sera signalé.

Là où l’ISO 42001 fait ses preuves

C’est ici que l’ISO 42001 devient utile sur le plan opérationnel, pas seulement comme logo. Les contrôles de l’Annexe B exigent le même inventaire IA, la même évaluation d’impact et la même documentation de supervision humaine que la Loi 25 attend. Un même exercice peut satisfaire à la fois le régulateur provincial et l’évaluation fournisseur d’un client international.

J’ai passé 21 ans en aviation militaire à l’intérieur de l’AF9000+, le système de gestion de la qualité fondé sur ISO 9001. La gouvernance de l’IA, c’est la même mécanique : système documenté, responsabilités claires, contrôles mesurables, preuves d’application. Ce que vous ne pouvez pas démontrer, vous ne pouvez pas le revendiquer.

Un aperçu de ce qui s’en vient

Les entreprises québécoises ont un avantage structurel. La Loi 25 est un banc d’essai pour ce à quoi ressemblera la réglementation fédérale canadienne quand la stratégie renouvelée du ministre Solomon sera lancée. Prendre les devants sur l’article 12.1, ce n’est pas seulement de la conformité provinciale. C’est une répétition générale pour ce qui remplacera l’AIDA.

Le mode de défaillance ordinaire n’a rien d’exotique. C’est un outil d’analytique, un trieur de CV ou un agent conversationnel qui roule sans ÉFVP, sans avis conforme à l’article 12.1, sans mécanisme de révision humaine documenté. Si votre organisation n’a pas inventorié ses outils IA en regard de la Loi 25 au cours des douze derniers mois, c’est la conversation qu’un auditeur entamera.